Pixelシリーズに「Gemini Live」でカメラに写ったものについて会話できる新機能追加

2025年4月8日(火)18時19分 ITmedia Mobile

この新機能は、すべての「Pixel 9」シリーズとSamsungの「Galaxy S25」で無料で利用できる。それ以外のPixelモデルでは、「Gemini Advanced」のサブスクリプションに加入していれば利用可能になる。

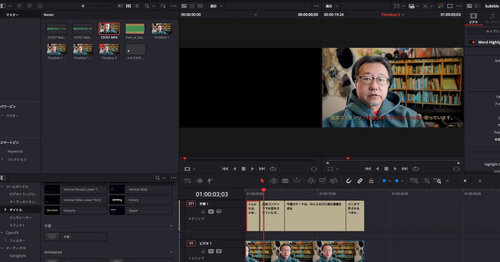

カメラを通して会話を開始するには、Pixelで電源ボタンを長押しし、「Live」ボタン(マイクアイコンの横にある3本の線のボタン)をタップする。画面下部左端にビデオカメラのアイコンが、その右隣に画面全体を共有するためのアイコンが表示される(下の左画像)。

カメラのアイコンをタップすることで、カメラの映像を共有しながらの会話をスタートできる(下の右画像)。

なお、Gemini Liveでカメラ機能を使用するには、ネット接続が必要だ。また、18歳未満は利用できない。

「Gemini Advanced」に加入している筆者が「Pixel 9 Pro」で少し試した範囲では、花の品種やキャラクターグッズの名称などを正確に答えた。

「Amazon Echo Spot」については最初「Google Nest Hub」だと答えたが、ロゴを“見せた”ところ、「おっと、これはAmazon Echo Spotでしたね。失礼しました」と訂正した。Googleは、生成AIは実験的なものであるため、Gemini Liveの応答の正確性は確認する必要があるとしている。

モノの名前を教えてくれるだけでなく、キャラクターの由来や、商品の場合はその使い方も説明する。Googleが紹介した例では、ネット接続が切れた原因について、「Nest Wi-Fi」でのチェック方法について説明している。

ブログ記事やソーシャルメディアの投稿、写真コレクションなどを見せて、改善点やフィードバックを得ることもできる。

Googleはこの機能について、3月の「MWC Barcelona 2025」で予告していた。

なお、Gemini Liveは現在、企業および教育機関向けアカウントでは利用できない。